Google 官方認證!提示詞 (Prompt) 實戰心法:從「直覺回話」到打造「數位分身」

最近稍微整理了谷歌 (Google) 官方文檔關於樣本提示(Prompting)的 Best Practice。意外的是,官方教的類型比想像中精簡,但後兩者確實是我在實務上極高頻率使用的「大招」。

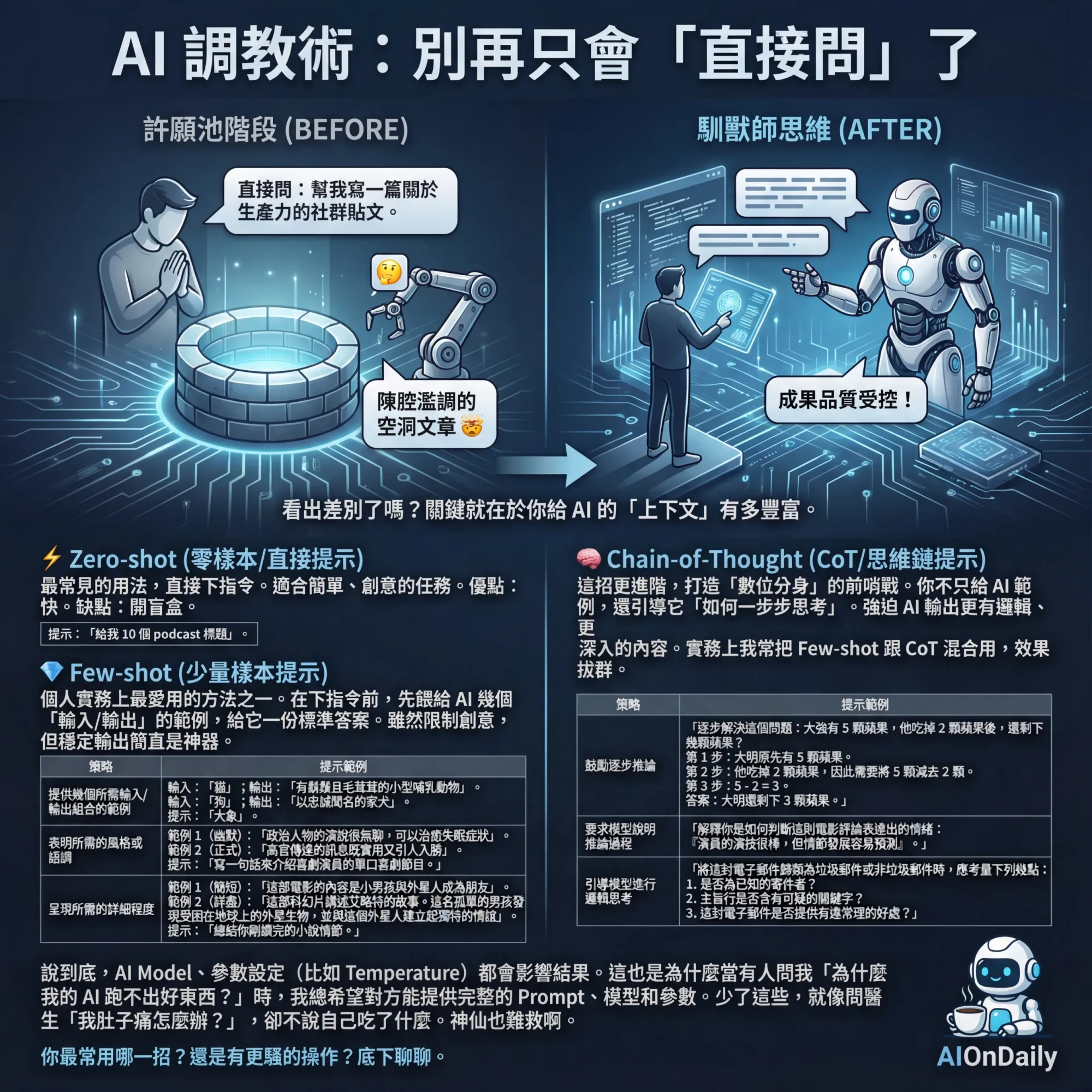

很多人常問:「為什麼 AI 總是回不到我想要的結果?」通常問題不在 AI 笨,而是你給的指令(Prompt)、參數(Temperature)或模型(Models)選錯了。今天 Aizen 就幫大家把官方精華結合實戰心得,一次整理給你。

目錄

- 直接提示 (Zero-shot):最直覺的「出張嘴」模式

- 樣本提示 (Few-shot):嚴格控管輸出的「範本流」

- 思維鏈提示 (Chain of Thought):打造數位分身的「邏輯流」

- Aizen 的實戰觀點:混合技與參數調教的藝術

1. 直接提示 (Zero-shot)

零樣本提示是指直接向模型提供指令或提問,完全不給予任何額外的說明或範例。

- 適用場景:構思點子(Brainstorming)、簡單的摘要、基礎翻譯。

- 例子:

- 「幫我列出五個關於 AI 科技報道的創意標題。」

- 「請將這段英文翻譯成繁體中文。」

分析與洞察:

這是最考驗模型「原生智力」的方法。如果你的需求很通用,Zero-shot 很快;但如果你有特定的排版或語氣要求,這招通常會讓你修得滿頭大汗。

2. 樣本提示 (Few-shot)

這種方法會先向模型提供一或多個想要的「輸入/輸出組合範例」,再呈現真正的提示。這能幫助模型瞭解任務的細節,進而生成精確的回覆。

2.1 實戰策略表

| 策略 | 提示範例 |

|---|---|

| 提供輸入/輸出範例 | 輸入:「貓」;輸出:「有鬍鬚且毛茸茸的小型哺乳動物」。提示:「大象」。 |

| 表明風格或語調 | 範例 1 (幽默):「政治人物的演說很無聊,可以治癒失眠症狀」。範例 2 (正式):「高官傳達的訊息既實用又引人入勝」。提示:「寫一句話來介紹喜劇演員的單口喜劇節目。」 |

| 呈現詳細程度 | 範例 1 (簡短):「這部電影的內容是小男孩與外星人成為朋友」。範例 2 (詳盡):「這部科幻片講述艾略特的故事。這名孤單的男孩發現受困在地球上的外星生物,並與這個外星人建立起獨特的情誼」。提示:「總結你剛讀完的小說情節。」 |

Aizen 的實戰觀點:

Few-shot 的好處在於可以極其嚴格地控制輸出格式。但缺點也顯而易見:給了範例後,AI 的創意性會稍微下降,它會變得非常聽話(甚至有點死板)。

3. 思維鏈提示 (Chain of Thought)

思維鏈 (CoT) 旨在鼓勵模型將複雜的推論細分成一系列「中間步驟」,最終生成條理分明的內容。

3.1 為什麼這是「數位分身」的前期?

CoT 的核心在於引導 AI 模擬個人的思維模式。當你要求 AI 解釋推論過程時,你其實是在把你的邏輯框架灌輸給它。

3.2 官方推薦策略

- 鼓勵逐步推論:

「大強有 5 顆蘋果,吃掉 2 顆後剩幾顆?請分步驟解決:第 1 步...第 2 步...」 - 要求說明推論過程:

「解釋你是如何判斷這則電影評論的情緒:『演員演技很棒,但情節容易預測』。」 - 引導邏輯思考:

「將電子郵件歸類為垃圾郵件時,請考量:1. 寄件者是否已知?2. 主旨是否有可疑關鍵字?」

graph TD

A[複雜問題] --> B{思維鏈 CoT}

B --> C[步驟 1: 拆解邏輯]

B --> D[步驟 2: 中間推論]

B --> E[步驟 3: 最終驗證]

C --> F[條理分明的輸出]

D --> F

E --> F

| 策略 | 提示範例 (Prompt Example) |

|---|---|

| 鼓勵逐步推論 | 「逐步解決這個問題:大強有 5 顆蘋果,他吃掉 2 顆後,還剩下幾顆? 第 1 步:大強原先有 5 顆蘋果。 第 2 步:他吃掉 2 顆,因此需要將 5 減去 2。 第 3 步:5 - 2 = 3。 答案:大強還剩下 3 顆蘋果。」 |

| 要求模型說明推論過程 | 「解釋你是如何判斷這則電影評論表達出的情緒:『演員的演技很棒,但情節發展容易預測』。」 |

| 引導模型進行邏輯思考 | 「將這封電子郵件歸類為垃圾郵件或非垃圾郵件時,應考量下列幾點: 1. 是否為已知的寄件者? 2. 主旨行是否含有可疑的關鍵字? 3. 這封電子郵件是否提供有違常理的好處?」 |

4. Aizen 的實戰觀點:混合技與參數調教的藝術

在實際操作中,我很少只用單一類型。現在的 Context Window(上下文視窗)隨便都很大,過去那種「怕字數太多 AI 會忘記」的限制已經小很多了。

4.1 混合技 (Few-shot + CoT)

我最常做的就是:給 2 個範例(Few-shot),並要求它在產出答案前先寫下推論邏輯(CoT)。 這樣既能保證格式正確,又能確保邏輯不翻車。

4.2 參數與模型的完美組合

當有人問我為什麼產不出預期結果時,我通常會要求對方提供這三要素:

- 完整 Prompt:你是用哪種提示類型?

- Model 類型:是用 Gemini 1.5 Pro 還是 Flash?(Pro 適合 CoT,Flash 適合 Zero-shot 快速反應)。

- Temperature (溫度值):

- 想要求精準、嚴格執行規則:Temperature 調低(例如 0.2)。

- 想要發想點子、寫文案:Temperature 調高(例如 0.8)。

4.3 總結

AI 時代,「出張嘴」也是有技術含量的。理解 Google 官方這三套基礎心法,並靈活運用 Few-shot 的「控管力」與 CoT 的「邏輯力」,你才能真正讓 AI 成為你的數位分身。

5. 參考文檔

[1] 提示工程:總覽和指南 https://cloud.google.com/discover/what-is-prompt-engineering?hl=zh-TW#prompt-engineering-overview-and-guide

[2] Tips to enhance your prompt-engineering abilities https://cloud.google.com/blog/products/application-development/five-best-practices-for-prompt-engineering